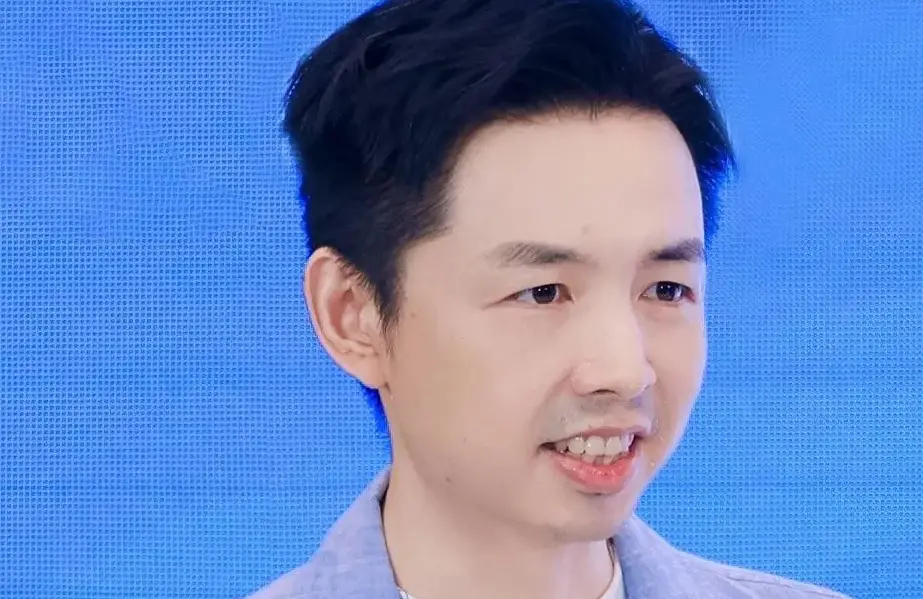

El invierno pasado, Jonathan Ross, cofundador y CEO de Groq, entró a una reunión con el CEO de Nvidia, Jensen Huang, con una propuesta para que la tecnología de ambas compañías trabajara en conjunto. Ahora explica esa sinergia con una analogía logística: dejar de construir centros de datos para IA como si todas las cargas de trabajo necesitaran el mismo hardware. El entrenamiento equivale al transporte de carga pesada; la inferencia, a la entrega de última milla.

Las GPU pueden encargarse de las dos tareas, pero usar un camión de gran porte cuando apenas necesitás una camioneta puede volver todo bastante más lento. En ese esquema, las GPU de propósito general de Nvidia son los camiones grandes. Los chips especializados de Groq, las LPU o unidades de procesamiento de lenguaje, diseñadas para ejecutar modelos con rapidez, son las camionetas más chicas. "Si estuvieras armando una red logística para todo Estados Unidos y yo te dijera que tus dos opciones son todos camiones de 18 ruedas o solo camionetas de reparto, ¿cuál elegirías?", dijo Ross. "La mejor respuesta es ambas", agregó.

Ross no llevaba apenas una idea sobre cómo debía pensarse el negocio. También buscaba la autorización de Nvidia para comprar unas 100.000 unidades Blackwell, probablemente valuadas en miles de millones de dólares. Huang lo llenó de preguntas sobre los detalles técnicos y, después de eso, la reunión terminó.

Cuando Huang lo llamó tres días más tarde, Ross esperaba una charla sobre su orden de compra de GPU. Pero el CEO de Nvidia fue directo al punto. "Probablemente deberíamos movernos muy rápido", recordó Ross que le dijo.

Tres semanas más tarde, Nvidia anunció un acuerdo de US$ 20.000 millones en Nochebuena para licenciar el producto de Groq y contratar a la mayor parte de su personal.

En los términos de Silicon Valley, se leyó como una fusión sin papeles: quedarse con el equipo, asegurarse la tecnología y obtener la ventaja estratégica sin heredar cada asunto pendiente en el altillo corporativo ni chocar con problemas antimonopolio. La empresa independiente que quedó de Groq, un proveedor de nube de LPU, todavía existe y crece, según le dijo Ross, ahora arquitecto jefe de software de Nvidia, a Forbes; además, exempleados dijeron el mes pasado que se espera una venta de la compañía, aunque eso todavía no pasó.

En ese momento, no todos le encontraban sentido, porque no estaba claro qué quería Nvidia de Groq más allá de un ciclo de prensa muy caro para dejar en claro que iba en serio con la inferencia. Incluso la explicación del propio Huang alimentó la confusión. "Les costó mucho atender la parte principal de las fábricas de IA", dijo en una conferencia a comienzos de este año. "Pero junto a nosotros, no tienen por qué hacerlo", completó.

Pero tres meses después, Nvidia dejó en claro cuáles eran sus planes al darle mucho espacio a Groq en su conferencia anual para desarrolladores. La empresa más chica no necesitaba volverse masiva por su cuenta. Le alcanzaba con resultar útil dentro de la compañía de IA más conocida, que ya tenía esa escala.

Para entonces, todos ya cobraron: Jonathan Ross se llevará una suma estimada de US$ 950 millones en efectivo, después de impuestos, a partir de su participación estimada del 9%; cuando se libere la compensación en acciones de Nvidia que recibió, probablemente una porción importante de los US$ 3.000 millones que la compañía habría reservado para los empleados que pasaron a Nvidia, se convertirá en un nuevo multimillonario.

Ross evitó hacer comentarios sobre su patrimonio, aunque habría valido mucho más si el acuerdo se hubiera cerrado como una operación con acciones o una venta de activos, en lugar de un convenio de licencia, mayormente en efectivo y con doble carga impositiva.

Otros grandes ganadores son el inversor Chamath Palihapitiya y su firma Social Capital, además del cofundador Doug Wightman, que tenía una participación estimada similar a la de Ross, y Sunny Madra, COO y presidente de Groq, a quien Ross le atribuyó haber destrabado el acuerdo. También aparece el gobierno de Estados Unidos: por la estructura de la operación, el fisco probablemente reciba más de US$ 6.000 millones en recaudación impositiva, aunque Nvidia también podrá aprovechar deducciones fiscales estimadas en US$ 3.000 millones.

En la conferencia anual para desarrolladores de Nvidia del lunes, Huang definió a 2026 como el año de la inferencia en IA, el proceso de usar inteligencia artificial en lugar de entrenarla.

Después anunció un nuevo producto para integrar los chips LPU especializados de Groq, reconocidos por acelerar al máximo la inferencia, con la nueva generación de GPU Vera Rubin de Nvidia. El mensaje de fondo fue claro: la etapa en la que la GPU resolvía todo empezó a chocar con una parte del mercado que ya no mira tanto quién lidera el entrenamiento, sino el costo, la latencia y el rendimiento a gran escala.

En los hechos, Nvidia, emblema de la monocultura de las GPU, avaló una idea distinta: muchas veces conviene usar algo que no sea una GPU. Los chips ya están en "producción total" y las entregas arrancarán este verano. Nvidia evitó precisar cuántos chips de Groq planea fabricar, aunque todo indica que serán muchos. "Puedo decir que es a escala Nvidia", dijo Ross. "Esto no es una prueba piloto", expresó.

Ross dijo que estuvo en "muchas" reuniones con clientes, aunque todavía no se anunció ningún comprador. "No sé si puedo confirmar ningún pedido en este momento", dijo Dion Harris, director sénior de computación de alto rendimiento e infraestructura de IA de Nvidia. "Es pronto, pero hay mucho interés", remarcó.

(Foto: Benjamin Fanjoy/Getty Images).

Los chips ya están en "producción plena" y las entregas empezarán este verano. Nvidia evitó precisar cuántos chips de Groq planea fabricar, aunque todo indica que serán muchos. "Puedo decir que será a escala de Nvidia", dijo Ross. "Esto no es una prueba piloto", destacó.

Ross contó que participó en "muchas" reuniones con clientes, aunque todavía no se anunció ningún comprador. "No sé si puedo confirmar ningún pedido en este momento", dijo Dion Harris, director sénior de computación de alto rendimiento e infraestructura de IA de Nvidia. "Es temprano, pero hay mucho interés", detalló.

De todos modos, el acuerdo reforzó la convicción del mercado en los chips de inferencia para IA, aunque la alianza entre Groq y Nvidia parece correr con ventaja en distribución, según otros referentes del sector. El nuevo producto, Nvidia Groq 3 LPX, "reconoce que las GPU por sí solas no atienden bien al mercado de inferencia, que crece más rápido", escribió Sam Fok, CEO de femtoAI, fabricante de chips de inferencia de IA para el edge. A su entender, herramientas de inferencia más baratas y accesibles van a destrabar una demanda mayor.

"Validó el mercado por el que venimos empujando desde hace tiempo", dijo Sid Sheth, cofundador y CEO de d-Matrix. "La próxima etapa del crecimiento de Nvidia va a venir de la inferencia", completó. En los últimos dos meses, Cerebras, competidora de Groq, anunció acuerdos con OpenAI y Amazon. A eso se sumó Jim Keller, CEO de Tenstorrent: Groq "abrió la puerta a la computación heterogénea... estoy seguro de que alguien hizo las cuentas", declaró.

Todo eso está muy bien, porque el acuerdo estuvo cerca de no concretarse. La estrategia de Nvidia apunta a ser la plataforma que el ecosistema no pueda esquivar, y los chips de inferencia son la incorporación más reciente. Así, pasó de ser una "buena idea" a quedar "respaldada por Nvidia".

(Foto: Nvidia).

Groq nació en 2016 como respuesta a una pregunta que buena parte del mercado todavía no se hacía: la inferencia ultrarrápida. "Groq estuvo cerca de morir muchas veces", le dijo Ross a Forbes en 2024. "Empezamos quizá demasiado pronto", agregó.

En 2023, siete años después de su creación, Groq facturó US$ 3 millones y registró pérdidas por US$ 88 millones. A mediados de 2024, cuando levantó US$ 640 millones con una valuación de US$ 2.800 millones, los ingresos todavía eran "relativamente insignificantes", según Mark Edwards, director de inversiones de Alumni Ventures, firma que invirtió por primera vez en Groq en 2021.

Dos fuentes le dijeron a Forbes que, por la época del acuerdo con Nvidia, la facturación anual de Groq rondaba los US$ 100 millones, muy por debajo de sus proyecciones iniciales para 2025, que según trascendió eran de US$ 2.000 millones y después bajaron a US$ 500 millones. Su contrato más relevante y su principal cliente era el fondo soberano de Arabia Saudita. Ross dijo que Groq marchaba "bien", que cumplía "algunos objetivos" y que hablaba con otros grandes clientes, aunque evitó hacer comentarios sobre los ingresos de 2025.

En los meses previos al acuerdo con Nvidia, Ross resaltó en público la sociedad de la empresa con vínculos con Arabia Saudita y aseguró que le generaría ingresos enormes. "No levantamos US$ 1.500 millones", sostuvo Ross hace un año en el podcast 20VC. "Eso es facturación. De hecho, equivale a cerca del 30% de la facturación de OpenAI", indicó.

Pero un exempleado le dijo a Forbes que esa cifra de impacto aludía al "valor acumulado de los servicios que iban a construir". Ese número probablemente incluía el costo total de construir el centro de datos que iba a alojar los chips de Groq, el valor de los propios chips y el de la potencia de cómputo que esos chips iban a generar, durante un período que no se precisó.

El acuerdo de Groq con Arabia Saudita, en particular con Aramco Digital, una subsidiaria tecnológica de la petrolera estatal, se estructuró como un reparto de ingresos, según contaron tres exempleados. Groq le vendería sus chips de IA a Aramco a un precio relativamente bajo; Aramco financiaría el centro de datos que iba a alojarlos; y las dos partes se repartirían los ingresos que generara la capacidad de cómputo de esos chips.

Además, no todas las "sociedades" respondían a una transacción limpia de efectivo a cambio de producto. En otra de las alianzas más visibles de Groq, con el REIT de centros de datos Equinix en Australia, Groq ocupa el lugar de cliente y le paga a Equinix hasta US$ 300 millones para alojar sus LPU y, a partir de eso, vender capacidad a sus clientes de nube. "Se parecía mucho más a que, sí, había un intercambio de fondos, pero también había mucho trueque de bienes", le dijo una fuente a Forbes.

No está claro cómo siguieron estos acuerdos dentro de Nvidia, ni en qué medida formaron parte de las conversaciones con la compañía. Ross sostuvo que eso solo influyó en la medida en que la empresa independiente de Groq sigue dándoles soporte a sus clientes de Arabia Saudita.

La integración que Nvidia presentó el lunes usa el chip de tercera generación de Groq. Según Ross, la segunda generación, que llegó con demora, todavía no había ganado escala, pero Groq pasó a una nueva versión porque integrarla con Nvidia iba a demandar tanto tiempo como arrancar de cero con una tercera.

Más allá de esos obstáculos, Ross aseguró que siempre se mantuvo confiado y con una ambición enorme. "Pensé que me iba a morir en Groq", recordó. "Siempre les dije a todos que queríamos entregar la mitad de la inferencia del mundo", expresó.

Aunque un exempleado dijo que el objetivo de Groq siempre fue trabajar con Nvidia, al principio Ross no estaba seguro de que los chips de Groq y las GPU de Nvidia fueran a integrarse bien. "Casi no lo hacemos", dijo Ross sobre la idea que le presentó a Huang a fines del año pasado. Según contó, Madra, ahora vicepresidente de Nvidia, lo convenció. Al final, la operación terminó como un encaje perfecto, tanto por negocio como por cultura, según Ross.

Ahora, la apuesta pasó de la teoría del acuerdo a la realidad del producto. Todavía es demasiado pronto para saber cómo rendirá el sistema Nvidia-Groq, bautizado LPX, porque aparece como una integración opcional dentro de la plataforma Vera Rubin de Nvidia y todavía no se usa a gran escala. En la conferencia del lunes, Huang indicó que podría destrabar US$ 300.000 millones en ingresos anuales por gigavatio y que espera que cerca del 25% de las cargas de trabajo de GPU se conecte con chips de Groq.

"Éramos como chicos en una juguetería", dijo Ross sobre su llegada a Nvidia. "De golpe, teníamos acceso a todo", relató.

*Este artículo fue publicado originalmente por Forbes.com